Всички

Най-чeтени

Технологии

С колко е по-бърз Windows 11 зависи от старите машини с Windows 10

Софтуер

Cloudflare иска AI ботовете да плащат на сайтовете за достъп до тях

Устройства

Nothing показаха своите нови смартфон Phone (3) и слушалки Headphone (1)

Технологии

Стартира World Computer Hacker League - четиримесечно глобално състезание за създаване на приложения от ново поколение

Софтуер

ZeRØ и No-FAT: нови технологии за хардуерна защита паметта на компютрите

Дигитализация

Meta обяви, че новият ѝ AI модел е по-консервативен политически, подобно на Grok

IT Бизнес

Акциите на Nvidia достигнаха нов връх, затвърждавайки позицията ѝ на AI лидер

Технологии

Intel поправи бъг, който засяга повечето ѝ процесори

Технологии

Смартфоните с Android скоро може да предупреждават кога някой ви подслушва

Технологии

С колко е по-бърз Windows 11 зависи от старите машини с Windows 10

Технологии

Стартира World Computer Hacker League - четиримесечно глобално състезание за създаване на приложения от ново поколение

Технологии

Пет технологични тренда при роботите за почистване

Технологии

Процесорите Ryzen на AMD продължават да размазват процесорите на Intel в Amazon

Технологии

ИТ гигантите се обединяват за обща платформа за AI агентите

Технологии

Samsung представи новият си чипсет Exynos 2500

Технологии

Папа Лъв XIV: Изкуственият интелект носи рискове за човешкото достойнство

Технологии

AMD заяви, че Ryzen Threadripper 9000 е с до 145% по-бърз от Intel Xeon

Как да

Как да разберем, че на хард диска не му остава много време

Как да

Как да увеличим скоростта на компютъра си

Как да

Как да генерираме видео, глас и изображения с Google AI Studio

Как да

Как да се справим със спам имейлите

Как да

Как да използваме Gemini AI за обобщаване на видеоклипове в YouTube

Устройства

Honor отново има най-тънкия сгъваем смартфон - Magic V5

Устройства

Nothing показаха своите нови смартфон Phone (3) и слушалки Headphone (1)

Устройства

Двата най-скъпи модела слушалки в света са събрани в новия шоурум на VSystem в София

Устройства

Google въвежда нови AI функционалности за Chromebook

Устройства

Ревю на умния контакт Shelly Outdoor Plug S Gen3

Устройства

Нова пълноразмерна клавиатура от Genesis

Устройства

Компанията на Тръмп пуска своя мобилна услуга, ще има и смартфон

Устройства

Huawei Pura 80 Ultra съчетава два телеобектива в една камера

Устройства

Survivor Torch - мощен, компактен и надежден фенер за всяка ситуация (Ревю)

Софтуер

Windows 12 се отлага: какво ново вместо него носи Windows 11 25H2

Софтуер

Cloudflare иска AI ботовете да плащат на сайтовете за достъп до тях

Софтуер

Microsoft променя Windows в опит да избегне катастрофи като с CrowdStrike

Софтуер

Google внедрява AI търсене и в YouTube

Софтуер

WinRAR спешно отстрани опасен бъг, позволяващ чрез архива да се стартира злонамерен софтуер

Телекоми

Трите телекома започват изграждането на дигитална свързаност в отдалечените региони

Телекоми

Срив и в мобилната мрежа на "А1 България", компанията предлага компенсации

Телекоми

„Училище за отговорни инфлуенсъри“ ще обучава и сертифицира създатели на съдържание

Телекоми

Мобилната мрежа на „Виваком“ се срина, заради софтуерен проблем

IT Бизнес

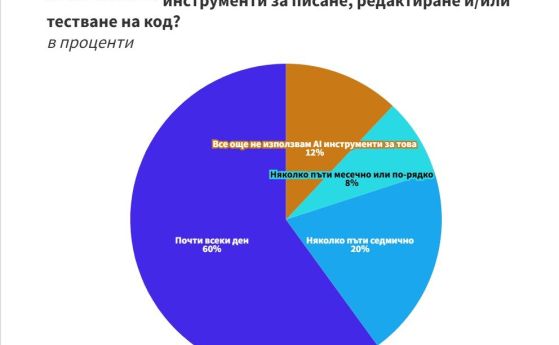

Над 88% от IT специалистите в България използват изкуствен интелект в работата си

IT Бизнес

Акциите на Nvidia достигнаха нов връх, затвърждавайки позицията ѝ на AI лидер

IT Бизнес

Над 4000 фиданки вече дарени от JAR Computers

IT Бизнес

САЩ: Китай е само на 2 години от постигане на технологичен паритет в чиповете

IT Бизнес

Близо половината от българите биха сменили работата си за по-висока заплата и бонуси сочи регионално проучване на wherewework

Fintech

САЩ прие законопроекта за стабилните криптовалути

Fintech

Генерирането на един Bitcoin става все по-скъпо и достигна 70 000 долара

Fintech

Как Sirma трансформира финансовите услуги