Дийп фейк видеата се превърнаха в сериозна тема през последните две-три години. Това са клипове, които се генерират с помощта на изкуствен интелект и могат да поставят практически всеки човек в доста реалистична, но несъществуваща ситуация.

От положителната си страна, технологията може да се използва за филми и игри – в чрез тях ще могат да се направят много по-реалистични персонажи, както и да се „помладят“ актьори. Това вече се прави и има все по-голямо приложение. Технологията обаче има и друга страна – подобни клипове да се използват за компромати, отмъщение, злепоставяне, измами и други сходни дейности.

Проблем е, че регулации практически няма. В Китай има действащ закон, който забранява създадено от изкуствен интелект съдържание да се разпространява без ясен маркер за неговия произход. Той изисква и авторите да се регистрират с реалните си имена при създателите на дадения софтуер.

В останалите страни по света обаче регулациите все още са на фаза предварителни дискусии. А дори и да ги има, това не означава, че няма да има злоупотреби. Засега единственото спасение е бдителността и специален софтуер, който да разпознава дийп фейк клипове.

И двете обаче са далеч от безгрешни, отбелязва IEEE Spectrum. За момента има няколко системи, които разпознават дийп фейкове. Една от тях е Real-Time Deepfake Detector на Intel. Платформата не е достъпна за крайни потребители, но може да се използва от социални мрежи, медии, организации, институции и т.н. Те могат да предложат на нейна база и инструменти за масовия потребител.

Разработката на Intel комбинира хардуер на компанията и софтуер, като може да използва и софтуер на трети лица. Целта на Intel в дългосрочен план е да използва няколко инструмента едновременно, като само един процесор вече може да анализира до 72 видео стрийма едновременно. Когато има и повече инструменти, вероятността дийп фейк видео да не бъде разпознато, ще е минимална.

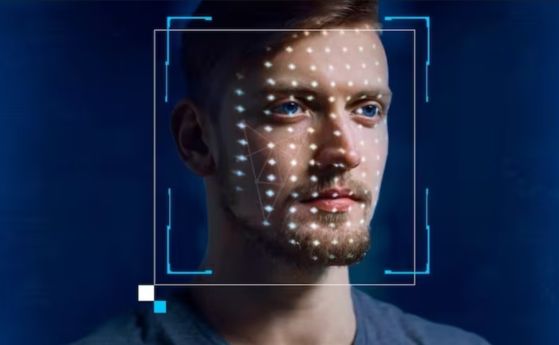

Един от тях ще е FakeCatcher. Той е разработен заедно с Университета на Бингхампътън. Софтуерът може да следи дори малки детайли като промяна на притока на кръв в лицето. Системата следи определени зони и може да разбере дали циркулацията на кръв в лицето е нормална или има отклонения в нея. При тестовете тя е постигнала 91% точност при засичането на дийп фейк клипове.

Друга система, PhaseForensics, на Университета на Калифорния, обръща внимание на устните и движението им. Точността при тестовете е до 94%, но може да варира.

Разработват се и системи за разпознаване на дийп фейк аудио записи, които стават популярни при телефонните измами. Проблемът е, че няма как да има универсално решение. Освен това дийп фейковете ще стават все по-добри и все по-трудни за засичане дори от специализиран софтуер. Други потенциални решения са добавяне на водни знаци и дори използване на блокчейн системи за гарантиране на произхода да дадено видео. Все още липсва единна посока на индустрията, което може да се окаже основният проблем за решаване преди всичко останало.

Коментари

Моля, регистрирайте се от TУК!

Ако вече имате регистрация, натиснете ТУК!

Няма коментари към тази новина !

Последни коментари